Почему 80% автотестов в итоге не окупаются

Вступление

Автоматизация тестирования почти всегда начинается одинаково. Мы пишем автотесты, ускоряем релизы, ловим баги раньше и вроде бы делаем бизнес счастливым. В первые месяцы всё действительно работает: тесты быстрые, фидбэк полезный, ручного тестирования меньше.

А потом проходит пару лет — и что-то идёт не так.

Автотесты начинают падать «просто потому что». Прогоны растягиваются на часы. Поддержка тестов съедает больше времени, чем разработка новых фич. А автоматизация, которая когда-то выглядела как инвестиция, всё больше напоминает дорогой технический долг.

В этой статье я хочу разобрать, почему так происходит. Без поиска виноватых и без лозунгов «автотесты — зло». С инженерной точки зрения: как обычно стартует автоматизация, какие решения кажутся разумными в начале и почему спустя несколько лет они начинают работать против продукта и команды.

Мы пройдём весь путь целиком — от первых десятков полезных тестов до состояния, когда поддержка автоматизации обходится бизнесу дороже, чем альтернативные способы контроля качества. И главное — разберёмся, почему в этот момент автотесты перестают окупаться, даже если формально «всё сделано правильно».

Это не статья про конкретные фреймворки или языки. Речь пойдёт о подходах, процессах и ограничениях, которые почти всегда игнорируются в начале — и именно поэтому определяют экономический результат автоматизации в долгосрочной перспективе.

Фаза 1. Рождение: максимальный профит

Автоматизация тестирования почти всегда начинается удивительно спокойно. Есть продукт, есть боль ручной проверки — и в какой-то момент становится очевидно: пора писать автотесты. Решение выглядит логичным, зрелым и абсолютно правильным.

Начинают обычно с API. Это быстро, стабильно и не требует больших жертв. Тестов немного, они выполняются за минуты, падают редко и почти всегда по делу. Архитектуру никто не продумывает — да и зачем? Когда тестов десятки, любые решения кажутся рабочими, а структура проекта выглядит вполне аккуратно.

Команда в этот момент маленькая — один-два человека. Поддержка тестов занимает считанные часы, ночные прогоны не пугают, а разбор падений не превращается в отдельную работу. Автотесты не мешают разработке и не требуют внимания всей команды.

Именно здесь автоматизация даёт максимальный эффект. Фидбэк быстрый, баги ловятся рано, ручного тестирования становится меньше. Каждый тест стоит дёшево и приносит ощутимую пользу бизнесу. Возникает ощущение, что система растёт сама по себе — без побочных эффектов и скрытых затрат.

И это ощущение обманчиво.

Проблем в этой фазе действительно нет — и именно поэтому она самая опасная. Всё работает слишком хорошо, чтобы задумываться о границах, ограничениях и цене роста. Кажется, что дальше нужно просто продолжать в том же духе.

Ничто не намекает, что этот баланс между пользой и стоимостью очень хрупок — и что позже за него придётся заплатить.

Фаза 2. Рост: первые костыли и первые иллюзии

Продукт растёт. Фич становится больше, сценариев — тоже, автотестов — ещё больше. Покрытие увеличивается, отчёты выглядят всё лучше, и создаётся ощущение, что автоматизация уверенно движется в правильном направлении.

Именно в этот момент она начинает усложняться.

Тесты всё ещё работают, но уже не так стабильно. Появляются первые флаки: то база не ответила, то электричество «моргнуло», то тест просто не дожил до конца прогона. Эти падения выглядят случайными и потому не пугают. Их списывают на рост системы и временные проблемы.

Прогоны становятся длиннее. Сотни тестов уже не пролетают за минуты, и команда начинает оптимизировать процесс. Появляются более сложные пайплайны, условия, фильтры, выборочные запуски. Всё это выглядит разумно — ведь цель та же самая: ускорить фидбэк.

Вокруг автотестов постепенно вырастает своя экосистема. Фреймворк обрастает обёртками и абстракциями, появляются локальные соглашения и «чуть более удобные» способы описывать сценарии. Система становится богаче, гибче и заметно сложнее.

И вместе с этим меняется роль самих тестов. Они перестают быть лёгким продолжением разработки и превращаются в отдельный поток работы. Автоматизация всё чаще отстаёт от продукта на спринт-два, а поддержка существующих сценариев начинает занимать ощутимую часть времени команды.

При этом кажется, что всё под контролем. Флаки — временные, пайплайны — временно сложные, абстракции — вынужденная мера роста. Возникает первая иллюзия: любые проблемы можно решить технически, просто добавив ещё немного инженерии.

Пока эти сигналы легко игнорировать. Система всё ещё полезна, а сложности не выглядят критичными. Но именно здесь начинает формироваться дисбаланс, который позже ударит по экономике автоматизации.

Фаза 3. Экономика ломается

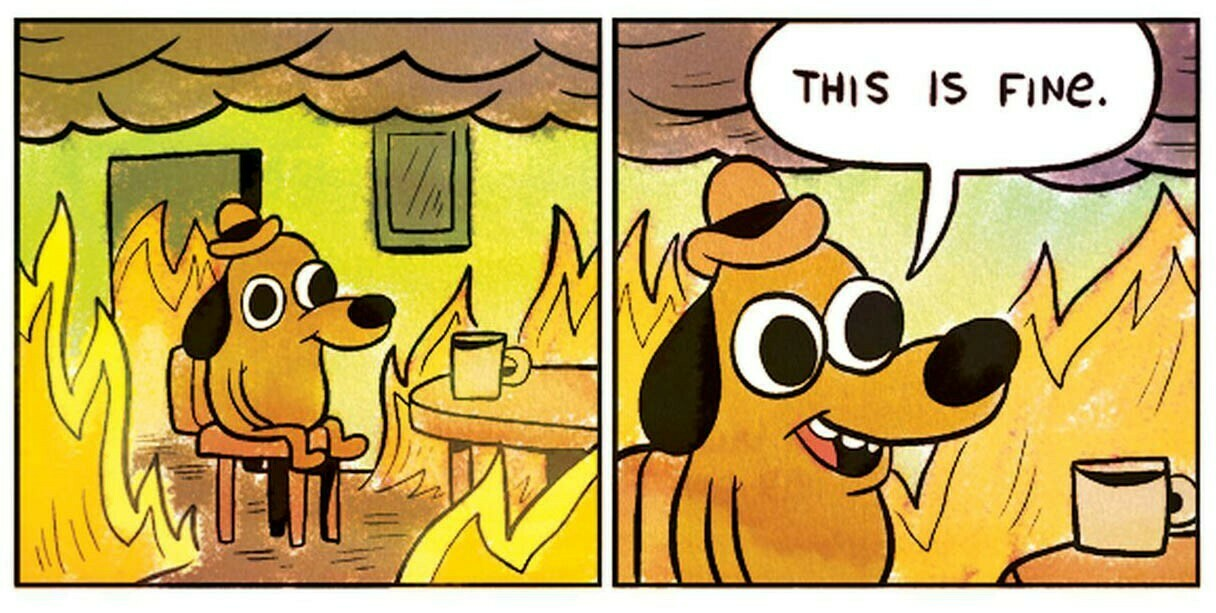

В какой-то момент появляется странное чувство. Формально всё развивается: тестов становится больше, фреймворк — сложнее, пайплайны — умнее. Работа кипит, метрики растут. И всё же внутри начинает чесаться мысль: а мы точно движемся в правильную сторону?

Если смотреть технически — всё неплохо.

Если смотреть экономически — что-то начинает ехать.

Каждый новый автотест вдруг оказывается не таким уж дешёвым. Его дольше писать, дольше запускать и заметно дольше разбирать, если что-то пошло не так. Прогоны растягиваются, фидбэк запаздывает, а флаки из редких аномалий превращаются в привычный фоновый шум.

При этом тесты не выглядят плохими. Наоборот — они аккуратные, продуманные, покрытие растёт, инфраструктура становится всё солиднее. Но возникает неприятный парадокс: суммарная стоимость одного сценария начинает превышать ту пользу, которую он приносит бизнесу. В какой-то момент автоматическая проверка оказывается дороже ручной.

Это быстро отражается на разработке. Автотесты всё чаще пишутся «потом», а не вместе с фичами. Автоматизация начинает жить в своём цикле и отставать от продукта на спринт-два. Поддержка существующего набора съедает основное время команды, а каждый новый тест воспринимается уже не как усиление, а как обязательство на будущее.

И вот здесь возникает тот самый диалог в голове:

«Что-то идёт не так?»

«Да нет, просто система растёт».

«Ну да, наверное».

Раньше этот момент был незаметен — его скрывали быстрые прогоны и дешёвые изменения. Теперь экономический дисбаланс выходит на поверхность. И становится понятно: максимальный профит остался в начале, когда тестов было мало, а система — простой.

И именно здесь появляется соблазн сделать следующий логичный шаг — попытаться всё починить.

Фаза 4. «Мы всё перепишем» — агония системы

В какой-то момент становится ясно: экономика автоматизации больше не сходится. И почти сразу появляется идея, знакомая до боли: нужно всё переписать. Не подкрутить, не упростить, а начать заново — уже «правильно» и с учётом накопленного опыта.

Проблему быстро находят в деталях реализации. Где-то много дублирования, где-то устаревшие библиотеки, где-то фреймворк оказался «слишком простым». Начинается большой рефакторинг. Появляется роадмап на месяцы: новые слои, новые правила, новые универсальные решения.

Старые костыли объявляются временными и неудачными — и заменяются новыми, аккуратными и куда более масштабными. Фреймворк обрастает абстракциями, инфраструктура усложняется, пайплайны становятся умнее. Система выглядит серьёзно, солидно и… заметно тяжелее.

Часто в этот момент появляется и отдельная роль — технический лидер автоматизации. Человек с большим опытом и искренним желанием сделать «как надо». Под его руководством почти всё становится настраиваемым, расширяемым и переопределяемым. Автоматизация превращается в полноценный инженерный продукт со своей архитектурой, правилами и философией.

Проблема в том, что меняется форма, но не фундамент. Подходы остаются прежними, границы — размытыми, а ограничения — теми же самыми. Новый фреймворк начинает повторять судьбу старого, просто на другом уровне сложности и с более современным стеком.

На короткой дистанции это работает. Прогоны стабилизируются, код становится аккуратнее, метрики — красивее. Возникает ощущение, что систему наконец-то выровняли. Но со временем автоматизация снова начинает расти, усложняться и тянуть за собой те же самые издержки.

Тестов становится больше, команда — больше, а основная часть усилий по-прежнему уходит на обслуживание самой системы. Формально всё стало «лучше», но экономический баланс так и не вернулся. Это и есть агония: автоматизация активно развивается, но всё меньше влияет на скорость и качество продукта.

И именно здесь становится понятно, что переписывание было не решением — а способом отложить разговор о настоящих причинах происходящего.

Конец. Иллюзия движения

К этому моменту автоматизация выглядит живой и даже бодрой. Что-то постоянно улучшается, оптимизируется, переписывается. Появляются новые пайплайны, правила, метрики. Команда занята, отчёты строятся, графики растут. Со стороны кажется, что система развивается и становится всё более зрелой.

Если остановиться и посмотреть внимательнее, становится заметно другое. Движение есть — но в основном внутри самой автоматизации. Большая часть усилий уходит не на ускорение релизов и помощь продукту, а на обслуживание системы, которая давно живёт по собственным законам.

В этот момент обычно приходит запоздалое осознание: что-то пошло не так. Хотя, если быть честным, пошло не так гораздо раньше. Просто в начале всё работало слишком хорошо, чтобы задавать неудобные вопросы.

Максимальный профит был тогда, когда тестов было мало: они были простыми, быстрыми и дешёвыми в поддержке. Дальше экономика начала медленно разворачиваться в другую сторону. Поддержка автотеста стала стоить дороже его ручной проверки, но этот расчёт никто не делал явно. Риски флаков, цена поддержки и влияние на скорость разработки просто не закладывались в модель.

Попытки «починить» ситуацию только усиливали эффект. Старые костыли заменялись новыми — аккуратными, универсальными и заметно более дорогими. Система становилась технически интереснее, но экономически — тяжелее. Фундамент при этом оставался тем же самым.

В итоге возникает устойчивая иллюзия движения. Команда работает, автоматизация живёт, метрики собираются. Но продукт и автотесты существуют в параллельных мирах, технический долг растёт, а бизнес не получает ожидаемого эффекта.

И самое неприятное здесь вот что. Причину всего этого каждый день можно увидеть в зеркале. Не потому что кто-то «плохой» или «некомпетентный», а потому что в начале никто не заложил границы, риски и реальную экономику автоматизации.

Поэтому автоматизация редко ломается резко. Она просто постепенно перестаёт быть инвестицией и превращается в дорогое движение по кругу — активное, сложное и всё менее полезное.

Главный вопрос: где всё сломалось?

Если оглянуться на всю эту историю, возникает логичный вопрос: в какой момент система свернула не туда? Ведь никто не планировал строить дорогую, медленную и нестабильную автоматизацию.

Ответ неприятно простой: ничего не сломалось внезапно. Ошибка была заложена в самом начале — в том, о чём не подумали и что не посчитали.

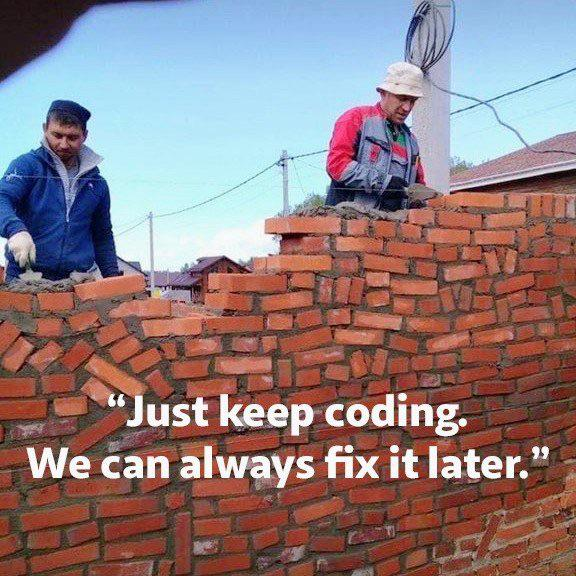

Автоматизацию начали строить как набор тестов, а не как инженерную систему. Без явных границ, без оценки рисков и без понимания стоимости владения. Флаки, нестабильные окружения, рост времени прогонов и цена поддержки не были частью модели — считалось, что «потом разберёмся».

В результате тесты начали проверять всё сразу. Инфраструктуру, интеграции, сеть, внешние сервисы и бизнес-логику — в одном сценарии. Без изоляции, без разделения уровней и без понятных контрактов. В этот момент почти никто не задавался вопросом, сколько такая автоматизация будет стоить бизнесу со временем и как это повлияет на разработку. Пока тестов было немного, это сходило с рук. Когда их стало сотни — система начала ломаться под собственной сложностью.

Дальше началось лечение симптомов. Ретраи, тайминги, умные ожидания, test impact analysis, всё более сложные фреймворки и инфраструктура. Вместо упрощения — усложнение. Вместо изоляции — ещё один слой абстракций. Система становилась технически богаче, но каждый такой шаг делал её дороже.

Параллельно тесты всё сильнее завязывались на реализацию. Любое изменение в архитектуре продукта превращалось в лавину падений — не потому что продукт стал хуже, а потому что тесты знали о нём слишком много.

И вишенка на торте — автоматизация жила отдельно от разработки. Тесты писались после фич, догоняли продукт и всё хуже отвечали на вопрос: что именно они гарантируют и какую ценность дают бизнесу?

По сути, дом перестраивали этаж за этажом, не трогая фундамент. А фундамент автоматизации — это не фреймворки и не пайплайны. Это изоляция, атомарность, простота, понятные контракты и встроенность в процесс разработки (left shift, а не «потом допишем»).

Когда этого нет, система может выглядеть активной и сложной, но для бизнеса она быстро перестаёт быть инвестицией и превращается в дорогое лечение симптомов.

И именно в этом месте автоматизация окончательно теряет экономический смысл.

Заключение

Автоматизация тестирования не равна профиту для бизнеса. Она окупается только тогда, когда её стоимость — прогоны, флаки, поддержка и влияние на скорость разработки — изначально посчитаны и ограничены. Во всех остальных случаях это просто дорогой способ создавать видимость контроля качества.

А для автоматизаторов главный вывод ещё проще. Нужно проектировать не автотесты и не структуру папок в тестовом фреймворке, а тестовую систему: с изоляцией, понятными контрактами, встроенностью в разработку и предсказуемой экономикой. Это работа не про код — это работа про инженерные решения и ответственность за результат.

Всё остальное — иллюзия движения.

Если в этой статье вы узнали знакомые проблемы — флаки, долгие прогоны, отсутствие доверия к тестам и ощущение, что автоматизация больше мешает, чем помогает — это нормальная ситуация. С этим рано или поздно сталкивается почти любая команда.

Вопрос не в том, как «починить» существующие тесты, а в том, как изначально проектировать тестовую систему так, чтобы эти проблемы не возникали.

Именно этому посвящён мой курс: «Автоматизация тестирования Backend с Python»

Это не курс про инструменты и не про «как написать ещё один тест». Он про:

-

изоляцию вместо флейков

-

детерминизм вместо ретраев

-

архитектуру тестовой системы вместо набора тестов

-

и самое главное — про экономику автоматизации

В курсе вы работаете с полноценным микросервисным стендом, Kafka, gRPC, базой данных, мок-сервисами и CI/CD, и учитесь строить автотесты, которым действительно можно доверять.

Если вам близок подход из этой статьи и вы хотите не просто понимать проблему, а уметь её решать — вам точно будет полезно.

По промокоду BACKBASE07QP1 — скидка 30%.

Автор: sound_right