Kimi K2.5 наступает на пятки GPT-5.4. И работает из России без VPN

Бенчмарков сейчас – как нейросетей: каждую неделю новый. GPQA Diamond тестирует PhD-знания. Lexometrica проверяет фактическую точность. LLM Persuasion Benchmark – способность убеждать в дебатах. Chatbot Arena – предпочтения живых людей. Резонный вопрос: зачем ещё один?

Два ответа. Первый: ценность бенчмарков – в перекрёстном подтверждении. GPT-5.4 – первое место у нас, в GPQA Diamond, в Lexometrica и в Persuasion Benchmark. Kimi K2.5 – шестое и у нас, и у Lexometrica. YandexGPT и GigaChat – внизу везде, где они вообще есть (в GPQA Diamond из 154 моделей – не попали). Четыре независимых бенчмарка – один и тот же вердикт.

Второй – важнее. Мы не нашли ни одного систематического бенчмарка, который тестирует российские модели бок о бок с глобальными на практических задачах. Если знаете такой – напишите в комментариях.

Наше исследование: 54 модели, 32 сценария на русском языке, промпты как пишет живой менеджер, два LLM-судьи с калибровкой. Обновление предыдущей статьи. Интерактивные результаты – на сайте.

Одно важное расхождение. Claude Sonnet 4.5 – второе место в нашем бенчмарке. В GPQA Diamond – в районе 17-го. Квантовую химию решает средне, зато когда задача – разобрать бюджет или спланировать проект – он лучше моделей, которые обходят его на PhD-задачах. Для менеджера GPQA – не тот бенчмарк, на который стоит ориентироваться.

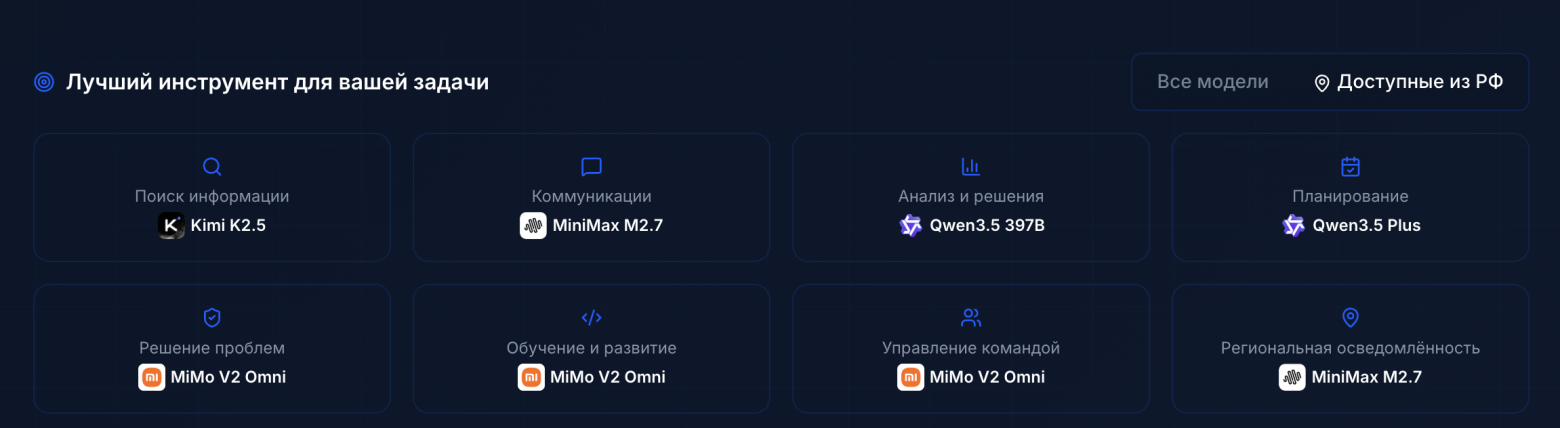

Что доступно из России без VPN

|

# |

Модель |

Балл |

Разработчик |

|---|---|---|---|

|

1 |

4,74 |

Moonshot AI |

|

|

2 |

4,69 |

MiniMax |

|

|

3 |

MiMo V2 Omni (только API) |

4,62 |

Xiaomi |

|

4 |

4,56 |

Alibaba |

|

|

5 |

4,55 |

Alibaba |

Пять из пяти – китайские. Ноль российских. Все работают без VPN, все бесплатны для базового использования.

GPT-5.4 (глобальный лидер) – 4,80. Kimi отстаёт на шесть сотых. На шкале от 1 до 5 это статистических шум, достойная конкуренция моделям. MiMo V2 от Xiaomi (да, той самой компании с телефонами) – на третьем месте. При этом стоит $0,40/M токенов на входе, а Gemini 2.5 Pro – $1,25/M. Дешевле в три раза, а набирает 4,62 против 4,46.

Какую модель для какой задачи

Claude доминирует в аналитике – планирование, анализ решений, решение проблем, управление командой. Не потому, что «умнее», а потому, что строит фреймворки: матрицы решений, деревья условий, пороги пересмотра. Там, где GPT даёт ответ, Claude даёт систему принятия решений.

GPT сильнее в поиске информации и коммуникации. Причём GPT-5 Mini ($0,002 за запрос) выдал лучший результат в категории «коммуникация» – 4,78, выше GPT-5.2 Pro. За качество общения необязательно платить премиум.

Снепшот из 54 моделей на сегодня по нашему бенчмарку – добавлю для истории

|

# |

Модель |

Балл |

|---|---|---|

|

1 |

GPT-5.4 |

4.80 |

|

2 |

Claude Sonnet 4.5 |

4.78 |

|

3 |

GPT-5.2 Pro |

4.78 |

|

4 |

Claude Opus 4.5 |

4.78 |

|

5 |

Claude Sonnet 4.6 |

4.77 |

|

6 |

Kimi K2.5 |

4.74 |

|

7 |

MiniMax M2.7 |

4.69 |

|

8 |

GPT-5 Mini |

4.69 |

|

9 |

GPT-5.2 |

4.69 |

|

10 |

GPT-5.4 Mini |

4.63 |

|

11 |

MiMo V2 Omni |

4.62 |

|

12 |

Claude Haiku 4.5 |

4.57 |

|

13 |

Qwen3.5 Plus |

4.56 |

|

14 |

Qwen3.5 397B |

4.55 |

|

15 |

GLM-5 |

4.50 |

|

16 |

Nemotron 3 Super |

4.48 |

|

17 |

Gemini 2.5 Pro |

4.46 |

|

18 |

DeepSeek V3.2 |

4.42 |

|

19 |

Qwen3 Max |

4.42 |

|

20 |

Gemini 2.5 Flash |

4.41 |

|

21 |

Qwen3 Max Thinking |

4.39 |

|

22 |

DeepSeek R1 |

4.33 |

|

23 |

Grok 4.1 Fast |

4.32 |

|

24 |

MiMo v2 Flash |

4.29 |

|

25 |

Gemini 3 Flash |

4.29 |

|

26 |

Mistral Large |

4.28 |

|

27 |

Grok 4 Fast |

4.25 |

|

28 |

MiniMax M2.5 |

4.24 |

|

29 |

Claude Sonnet 4.0 |

4.22 |

|

30 |

MiniMax M1 |

4.14 |

|

31 |

Grok 4 |

4.14 |

|

32 |

Grok 3 |

4.13 |

|

33 |

Qwen3.5 9B |

4.11 |

|

34 |

Mistral Small 4 |

4.05 |

|

35 |

Perplexity Sonar Pro |

4.03 |

|

36 |

Perplexity Sonar |

4.00 |

|

37 |

Qwen3 235B |

3.97 |

|

38 |

Alice AI LLM (Yandex) |

3.86 |

|

39 |

Gemma 3 27B |

3.75 |

|

40 |

Qwen3 32B |

3.67 |

|

41 |

Gemma 3 12B |

3.58 |

|

42 |

Gemma 3 4B |

3.27 |

|

43 |

GigaChat-Ultra |

3.26 |

|

44 |

GigaChat-Ultra Thinking |

3.15 |

|

45 |

YandexGPT Pro 5.1 |

3.13 |

|

46 |

GPT-4o |

3.08 |

|

47 |

GigaChat-2-Max |

3.08 |

|

48 |

GigaChat-Max-preview |

3.05 |

|

49 |

Llama 4 Maverick |

2.95 |

|

50 |

GigaChat-Pro-preview |

2.90 |

|

51 |

YandexGPT Pro 5 |

2.85 |

|

52 |

GigaChat-2-Pro |

2.82 |

|

53 |

YandexGPT Lite |

2.61 |

|

54 |

Phi-4 |

2.27 |

MiniMax M2.7 – лучший в тесте по управлению командой: «исключительно детальные планы собеседований, развития карьеры и управления изменениями с конкретными формулировками и сроками». Иногда проскакивают иероглифы в русском тексте – артефакт генерации, но по сути лучше всех.

Среди доступных из России Kimi и MiniMax укладываются в 0,1–0,2 балла от лидера в каждой категории. Нет ни одной задачи, где VPN был бы обязательным условием качественного результата.

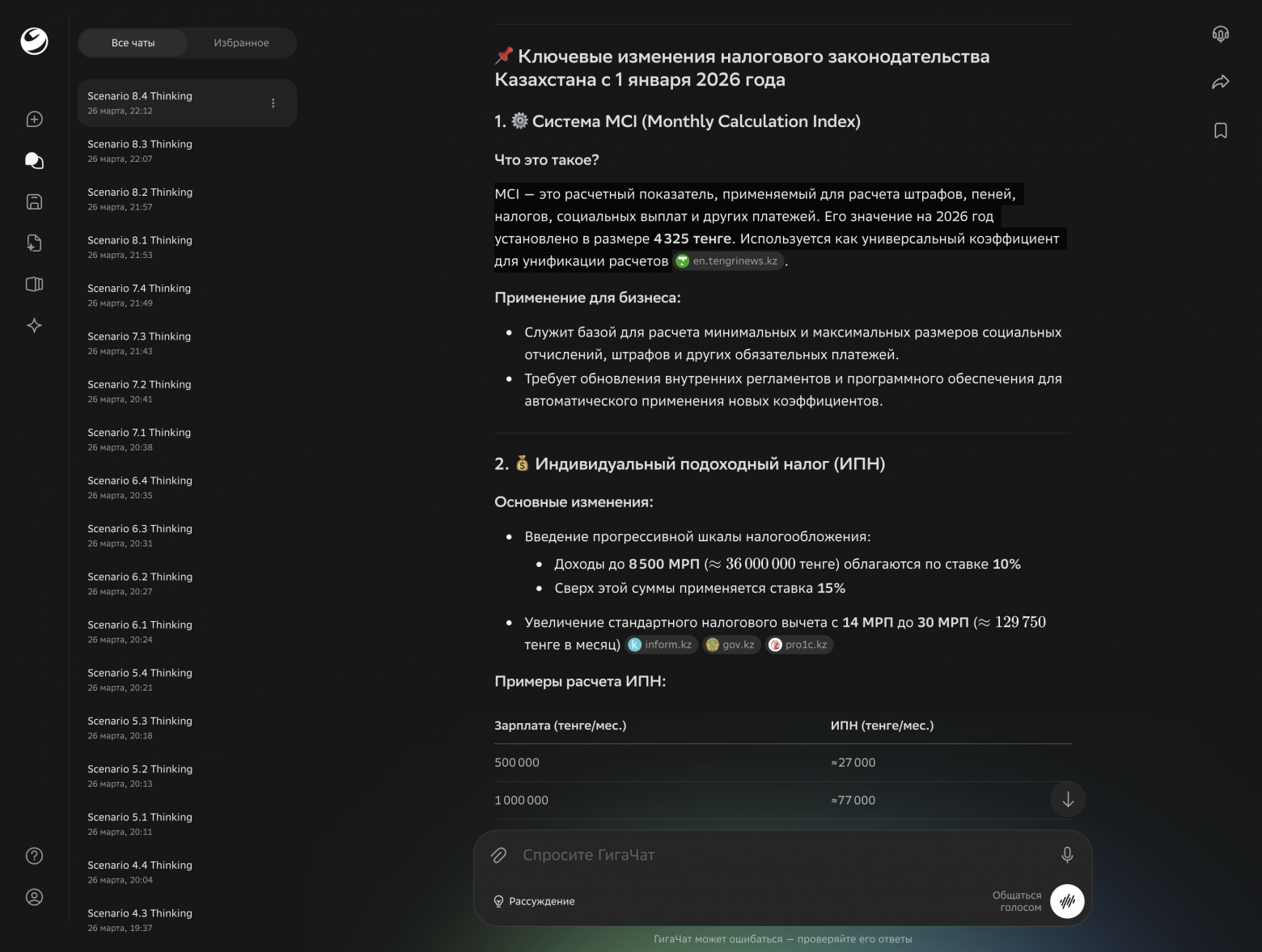

Как это выглядит на практике

Цифры – абстракция. Вот конкретный сценарий из нашего бенчмарка: $100 тысяч и четыре инициативы – ПО для управления проектами ($30K), подрядчик ($45K), обучение ($20K), маркетинг ($40K). Бюджета на всё не хватает. Пять моделей, пять подходов. Привожу места и баллы для понимания значимости нашей шкалы.

-

Kimi K2.5 (#6 в рейтинге) разбил инициативы на портфельные категории: базовый актив, асимметричная ставка, долгосрочный хедж, резерв. Отсёк контрактора: «операционная заплатка без накопления активов». Предложил пороги отказа: CAC > $200 – исключить маркетинг, defect rate > 5% – исключить ПО. Условная логика, сценарии, метрики для пересмотра.

-

MiniMax M2.7 (#7, 4,69) – расчёт ожидаемой ценности каждой инициативы, поэтапный план с критериями перехода. Менее креативно, так же пригодно для совещания.

-

Qwen3.5 Plus (#13, 4,56) – сильный финансовый анализ с учётом скрытых затрат. Но нюанс: «склонна выбирать политически выгодный вариант вместо менее рискованного». Модель скорее подстроится под руководство, чем скажет неудобную правду.

-

GigaChat Ultra (#43, 3,75) начал с Python-кода, который считает арифметику. Профинансировал контрактора, исключил маркетинг: «откладывается до появления подтверждённых данных». Ни условной логики, ни порогов, ни фреймворка.

-

Alice AI (#38, 3,86 в среднем) – хорошо структурирует, выделяет корреляции. Но системная проблема: ответы обрываются на середине. Судья: «40–60% задания остаётся невыполненным». Вы ждёте план онбординга, а модель замолкает на третьем пункте из семи.

Разница между 4,75 и 3,75 – не в десятых. Разница в том, что с результатом Kimi можно идти на совещание, а результат GigaChat нужно переделывать.

Почему российские модели отстают

Мы протестировали пять версий GigaChat и три модели Яндекса. Картина однородная.

GigaChat-Ultra – лучшая от Сбера: 3,26. Судья заключил: «анализ часто поверхностный, допускает фактические ошибки в цифрах и ценах, систематически подменяет контекст – вместо запрошенного рынка анализирует российский». GigaChat-2-Pro – 2,82, худший результат среди всех 54 моделей. Сбер продолжает публиковать внутренние бенчмарки о превосходстве над DeepSeek V3. GigaChat-Ultra, которую мы тестировали – и есть модель 3.1. Она набрала 3,26. Ценовой контекст: $0,023 за запрос – почти столько же, сколько Claude Sonnet 4.5 ($0,017), который набирает 4,78.

Alice AI (Яндекс) – лучшая российская: 3,86. Но разрыв с Kimi – 0,88 балла, почти целый балл. YandexGPT Pro 5.1 (3,13) – в половине сценариев по поиску информации отказался выполнять задачу, сославшись «на отсутствие актуальных данных», хотя речь шла об общеизвестных продуктах.

Отдельная ирония: в категории «Региональная осведомлённость» (ТК РФ, налоги, культура России и Казахстана) – казалось бы, домашнее поле – GigaChat-Ultra в режиме Рассуждений получил 2,35 с пометкой «POTENTIAL_HALLUCINATION». Перепутала МЦИ с Месячным расчётным показателем, указала неверную ставку социального налога. Kimi K2.5 на том же сценарии – 3,85, корректно идентифицировал ошибку в условии. YandexGPT – отказался отвечать. Китайская модель знает казахстанское налоговое право лучше российских.

Что из этого следует

Проблема доступа для российских пользователей решена. Не российскими компаниями – китайскими. Kimi, MiniMax, Qwen работают из России, бесплатны для базового использования и находятся на уровне глобального паритета. Год назад лучшая доступная модель отставала от топа на 0,4 балла. Сейчас – на 0,06.

Российские модели обслуживают другой рынок: корпоративный комплаенс, госзакупки, «импортозамещение». Не конкуренция по качеству – наблюдение из данных.

Но вот что важно понимать: разница между Kimi (4,75) и GigaChat (3,75) на том же сценарии с бюджетом – это не только разница моделей. Это разница в подходе. Структурированный промпт с контекстом, ролью и форматом ответа вытягивает даже слабую модель. Размытый «распредели бюджет» роняет даже сильную. В нашем бенчмарке мы намеренно использовали промпты «наивного менеджера» – без оптимизации. В реальной работе правильный промпт закрывает половину разрыва между моделями.

Именно этому – как формулировать задачи для ИИ так, чтобы результат можно было использовать – это отдельный навык.

Конкретные цифры устареют через месяц. Структурный паттерн – нет: разрыв между «глобальным топом» и «доступным в России» сжимается каждый квартал, и сжимается по тому, что китайские модели становятся доступнее, а не по причине, что российские – лучше.

Автор: bstan